Google heeft tijdens Google Cloud Next 2026 in Las Vegas de 8e generatie TPU’s gepresenteerd en voor het eerst introduceert het twee TPU’s tegelijk, waarbij inferentie en training worden gescheiden. De TPU 8t en TPU 8i zijn in zijn geheel opnieuw ontworpen, elk voor een fundamenteel ander doel. Google weet hiermee een enorme sprong voorwaarts te maken in prestaties en efficiëntie. Het biedt hiermee een alternatieve infrastructuur voor Nvidia. De grote vraag is of het organisaties kan overtuigen te kiezen voor de Google AI-infrastructuur.

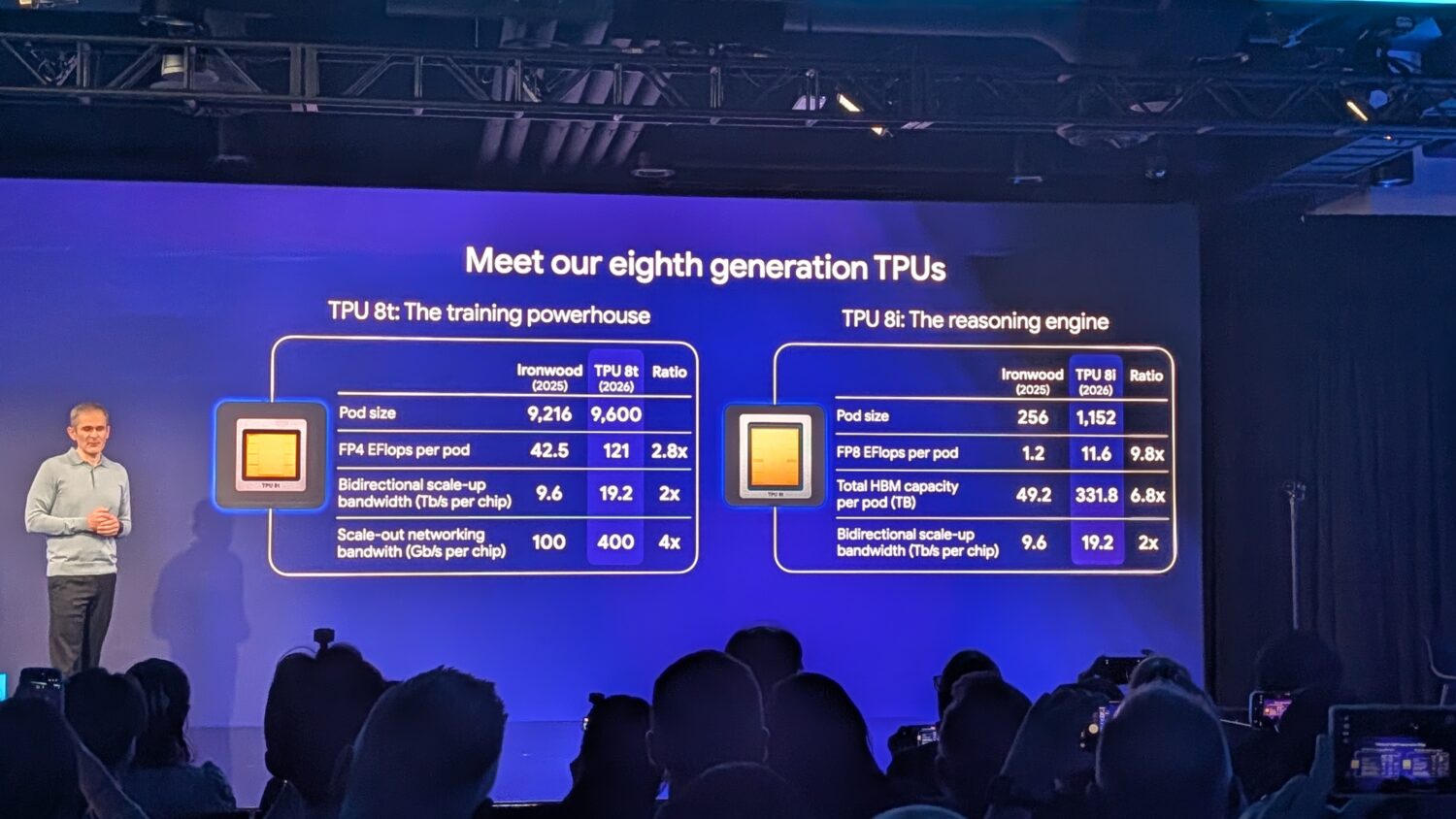

Een jaar geleden stond Google op hetzelfde podium in Las Vegas om Ironwood te presenteren, de zevende generatie TPU die destijds de krachtigste AI-chip van Google was. Ironwood was al een significante stap voorwaarts met tot 42,5 ExaFlops per pod, 192 GB HBM per chip. Ook toen sprak Google al over een focus op inferentie. Nu, een jaar later, presenteert Google twee opvolgers.

Twee chips, beide met hun eigen doel

De aanleiding voor deze opsplitsing is logisch. Training en inferentie zijn fundamenteel verschillende workloads met andere eisen. Training vraagt om maximale rekenkracht, enorme schaalbaarheid en hoge bandbreedte. Inferentie daarentegen, vraagt om lage latency (zeker met AI-agents), meer HBM capaciteit per pod en efficiënte communicatie tussen grote aantallen chips in realtime. Daarom stapt Google over op een strategie met aparte chips voor Training en Inferentie. Dat zijn de TPU 8t en 8i geworden, waarbij de T staat voor training en de i voor inference.

TPU 8t: het trainingsbeest

De TPU 8t is gebouwd voor één ding: het zo snel mogelijk trainen van frontier-modellen. Google claimt dat de ontwikkelcyclus voor grote modellen hiermee van maanden naar weken kan teruggebracht worden. De cijfers ondersteunen die ambitie.

Een enkele TPU 8t superpod kan nu 9.600 chips bevatten, wat vergelijkbaar is met Ironwood, echter levert deze nieuwe superpod bijna drie keer zoveel rekenkracht, 121 Exaflops. De totale geheugenpool van de pod bedraagt twee petabyte HBM met een verdubbeling van de snelheid tussen de chips.

Opvallend is de introductie van het Virgo Network: het nieuwe scale-outfabric van Google waarmee TPU 8t kan opschalen tot 134.000 in enkele fabric in één datacenter, maar tot één miljoen chips in trainingscluster met meerdere datacenters. Dat is geen theoretische limiet voor de toekomst, maar de architectuur waarop Google’s eigen modeltrainingscapaciteit de komende jaren wordt gebouwd.

Naast de enorme rekenkracht is er ook focus op betrouwbaarheid. De TPU 8t is ontworpen voor meer dan 97% zogeheten “goodput”: de verhouding van productieve rekentijd ten opzichte van totale uptime. Bij het trainen van modellen telt elke seconde of elke procent, want één procent minder betekent vaak dagen langer trainen. Het Virgo Network is ook zo ontworpen dat het automatisch storingen detecteert en oplost, dat gebeurt met real-time telemetrie over tienduizenden chips. Zo is er automatische omleiding bij defecte chips of verbroken verbindingen. Waarbij het netwerk zichzelf automatisch herconfigureert zonder menselijke tussenkomst terwijl de modeltraining gewoon doorloopt.

TPU 8i: de inferentiechip

De TPU 8i is uiteindelijk de interessantste van de twee, want de meeste organisaties trainen geen modellen, maar gebruiken modellen. Om een AI-model te gebruiken heb je een inferencechip nodig, zoals de TPU 8i. De overgang van enkelvoudige modellen naar AI-agents die met elkaar communiceren en taken uitvoeren zorgt voor een veel hogere vraag naar inferentie.

Dat is ook terug te zien in de pod-configuratie van de TPU 8i. In plaats van 256 chips bij Ironwood kunen er nu 1.152 chips in één pod. Daarmee kan een enkele TPU 8i-pod enorm veel rekenkracht leveren.

Google heeft enkele specifieke problemen aangepakt die de prestaties bij inferentie op schaal belemmerden:

De TPU 8i beschikt over meer HBM geheugen dan zijn voorganger, 288 GB HBM gecombineerd met 384 MB on-chip SRAM. Hiermee kan er een grotere workload in het geheugen worden opgeslagen, wat de latency verlaagd.

Het aantal fysieke CPU-hosts per server is verdubbeld, waardoor er meer ondersteuning is vanuit de CPU en workloads nog sneller kunnen worden uitgevoerd. Hiervoor stapt Google ook over op de eigen Axion ARM-processoren. Die zeer goed kunnen samenwerken met de eigen Google TPU’s.

De latency is verder verlaagd door de bandbreedte tussen de chips te verdubbelen naar 19,2 Tb/s, maar ook door de netwerkdiameter te reduceren met 50%. Dit is wat Google noemt de Boardfly-architectuur.

Alles bij elkaar zorgt deze nieuwe chip voor meer rekenkracht en efficiëntie, terwijl het stroomverbruik is gedaald. Google stelt 2x zoveel prestaties per watt en spreekt over een 80 procent betere prijs-prestatieverhouding ten opzichte van Ironwood.

Lees ook: Google Cloud versnelt AI-ontwikkeling met nieuwe TPU en VM’s

Google bouwt volledige stack

Wat Google onderscheidt van de rest van de industrie is niet één enkele chip of AI-model, maar de integratie tussen alle componenten. Van het silicon, netwerk, datacenter tot aan de stroomvoorziening, de software en de AI-modellen. Doordat Google alles in eigen beheer heeft kan het alles beter op elkaar afstemmen en hogere prestaties realiseren.

Om organisaties te overtuigen is meer nodig. Zo laat Google weten dat er brede softwareondersteuning is; JAX, MaxText, PyTorch, SGLang en vLLM worden native ondersteund. Bare metal-toegang is beschikbaar, dit betekent dat klanten directe hardwaretoegang krijgen zonder de overhead van virtualisatie. De chips van Google zijn niet los verkrijgbaar enkel via de Google Cloud, dus als je als organisatie hiervoor kiest zit je er wel min of meer aan vast.

Google ondersteunt wel de bekende softwaretools die bijvoorbeeld ook veel met Nvidia-chips worden gebruikt, maar als je eenmaal in de Google infrastructuur stapt met alle tooling die het bedrijf erbij levert, is de kans dat je nog overstapt op een Nvidia-infrastructuur wel een stuk kleiner. Dat vraag uiteindelijk toch om veel aanpassingen.

Beschikbaarheid

Beide chips worden later dit jaar algemeen beschikbaar via Google Cloud. Een exacte datum heeft Google nog niet gecommuniceerd. De chips zijn al twee jaar in ontwikkeling en Google gaat ze zelf intern op grotere schaal inzetten voor de eigen diensten en uiteraard de eigen modeltrainingen.

De prestatiesprongen zijn indrukwekkend, elk jaar weet Google meer uit zijn eigen chips te halen. Google ontwikkelt de chips voor zichzelf en als commercieel product voor Google Cloud. Google kan zelf al flink wat van de chips gebruiken, de vraag is of het ook klanten massaal warm gaat krijgen voor de nieuwe chips en de bijbehorende infrastructuur. Sommige organisaties zijn bang voor lock-in, met Nvidia-chips zit je ook vast aan Nvidia, maar kan je nog wel het platform en de servers elders afnemen en in een eigen datacenter zetten.

:format(jpeg):fill(f8f8f8,true)/s3/static.nrc.nl/wp-content/uploads/2025/06/24095735/data132931524-38215c.png)

English (US) ·

English (US) ·